AI推理下的CPU“打怪”进阶之路

AIGC时代,新的计算范式正在探索发展之中。用CPU加速AI推理过程,这已经是被实践检验和验证的最佳路径。CPU在执行涉及大量顺序计算的推理任务时尤为高效。QYResearch的调研报告显示,2023年全球AI推理服务器市场规模大约为740亿元,预计到2030年将增加到2676亿元,年复合增长率高达18.9%。

AI推理在高性能计算资源方面的持续放量,将进一步激发CPU的创新。

AI推理需要什么样的CPU?

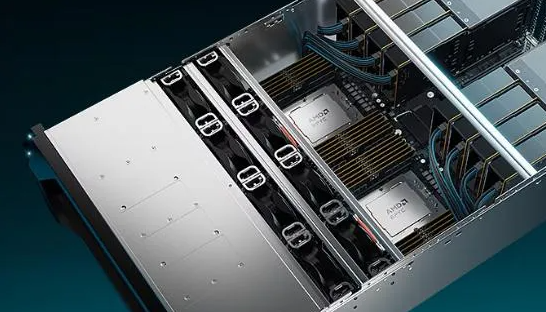

服务器机头是服务器的核心部件,主要用于管理和协调计算集群的服务器节点。在常见的高端AI服务器上,每8个GPU就要配备2个CPU,即是想通过CPU来协调和管理相关的加速硬件,确保高效协同地工作,加速数据处理和AI推理。

CPU是服务器机头中最重要的组成部分,负责执行指令和处理数据,可谓重中之重。CPU的性能和能力直接决定了服务器的整体性能和处理效果。因此,用户在选择AI推理服务器时,评估CPU的整体性能是非常重要且必要的。面向不同的应用场景和工作负载,选择架构最优,性能、核心数量、线程数量等指标完美匹配应用需求的CPU也是一门学问。

所谓AI推理,即利用训练好的模型对新的数据进行预测和分析,它对服务器提出了高性能、高可扩展性、低延迟、高安全性等更为严苛的要求。

1.频率高,性能更高

在AI推理过程中,CPU的频率是一项十分重要的性能指标,因为它直接影响到计算速度与效率。高主频的CPU能够提供更快的计算速度,这对于处理复杂的AI推理任务来说是必须的。根据实践经验,选择高主频的CPU,才能确保在处理大量数据和复杂计算任务时,CPU能够从容自如,性能与效率比翼齐飞。此外,在处理多个任务时,多核处理器可以更加游刃有余,有效提升AI推理的速度。

AMD第四代EPYC处理器平台(Genoa)采用Zen 4微架构,主要面向的就是人工智能、多云工作负载、高性能计算、实时分析等场景。AMD Genoa CPU的主频是3.51GHz。在GeekBench 5基准测试中,AMD Genoa CPU的单核成绩为1460分,多核成绩为96535分,表明其在多核性能上比上一代EPYC Milan 7763有了显著提升,多核性能提升28%。

AMD Genoa CPU不仅具有更高的核心频率,还能支持更多的核心数同时达到最高频率,这也让它成了AI推理的理想之选。

2.大缓存,好处多

通常来说,拥有三级缓存的CPU在处理海量数据和高并发任务时,具有更高的效率,能够大幅度提升多任务处理和多线程应用的性能。所以,对于需要高性能计算的AI推理来说,三级缓存是更优的选择。在AI推理过程中,需要处理已训练模型的决策或识别,涉及复杂逻辑、控制流任务和大量数据。对于CPU而言,高速的L1和L2缓存,协同大容量的L3缓存,能够达到更高的缓存命中率(意味着大部分数据可以在缓存中找到,而无需从主存储器中读取),因此能够加快AI模型的处理和分析。

与上一代EPYC Milan相比,AMD Genoa除了将L2缓存容量翻倍,提升至每核心1MB,还能支撑每8个核心共享32MB三级缓存。而AMD Genoa-X系统则能提供每8个核心共享96M三级缓存,从而为AI推理业务提供了更加强大的助力。

3.内存大而快,推理稳且迅

对于AI推理应用来说,CPU的内存速率一直是个关键要素,因为它直接关系到模型加载、数据处理和结果输出的速度。较高的内存速率,意味着CPU能够更快速地处理大量数据,提高AI推理的效率。另外,CPU的内存容量也不容忽视。随着模型持续“膨胀”,内存容量也要水涨船高。CPU通过增加更多的内存通道,能够支持更大的内存容量、提供更大的内存带宽,同时也能更好地适配DDR5内存,这对于提升处理器的整体性能至关重要。只有内存容量与速率同步增长,才能更好地胜任AI推理任务。

AMD Genoa系列所有型号的CPU均支持高达4800MT/s的DDR5内存速度,双路理论上可支持的内存带宽最大可达920Gbps。另外,每个AMD Genoa CPU拥有12个内存通道,支持多达24个DIMM模块。这些特性使得AMD Genoa能够为AI推理提供充足的内存带宽和容量。AMD Genoa CPU的内存设计兼顾了效率与稳定性,基于高速的DDR5内存与优化的内存架构,可以确保高负载情况下系统的稳定运行和数据处理的快速响应。总之,AMD Genoa CPU不会在内存上“掉链子”。

唯一同时拥有GPU、CPU、FPGA平台性解决方案的AMD,其全面性以及针对特定应用需求的设计和优化能力,使其在AIGC时代能够继续挺立潮头。尤其是在AI推理应用中,AMD EPYC CPU受到了众多企业用户的青睐。AMD第四代Genoa EPYC 9004系列的推出,让AI推理的执行能力又迈上了一个新台阶。

AMD EPYC是“多面手”

从金融安全到气象预报,从医疗诊断到游戏娱乐,AI推理技术应用的场景可谓五花八门、多种多样。也正因为如此,针对不同的应用领域和具体的场景,选择最适合的服务器乃至CPU型号,才能做到事半功倍。

面向AI推理选择CPU时,应综合考虑其计算速度、延迟、AI优化能力、性价比,以及软件生态等诸多因素,以确保AI推理应用的性能和效率都能达到最佳。从AMD EPYC 9334、AMD EPYC 9454、AMD EPYC 9534等CPU的性能以及综合能力来看,都能各自撑起AI推理应用的一片天。

从相似之处来说,AMD EPYC 9334、AMD EPYC 9454、AMD EPYC 9534都具有高主频、多核心、大带宽等优势,具有非常优异的性价比和能效比。举例来说,由于Zen 4架构的引入,AMD EPYC 9004相比上一代产品,在每时钟周期执行指令数上提升了约14%,再加上更高的频率,大大提升了性能。再比如,AMD EPYC 9004拥有更多的核心与线程数量,相比上一代产品增加了50%,最高可达96个核心,而且支持同步多线程,兼具高并发与低延迟的优势。另外,AMD EPYC 9004引入了DDR5内存,这是目前较新的内存标准,再加上扩展到12个内存通道,以及多达128条PCIe 5.0通道,如同为大规模数据传输铺就了“高速公路”,使得CPU在处理海量数据和高性能计算任务时,具有更高的效率和速度。AMD EPYC 9004整体上的优异表现,让AI推理变得更加快捷高效。

AMD EPYC 9334、AMD EPYC 9454、AMD EPYC 9534又各具所长,能够满足不同用户和特定工作负载的需求。AMD EPYC 9334 2.70GHz 32核处理器集更多功能于一身,通用性最强,并以高性能、高效率、强大的虚拟化能力和出色的散热管理著称,可以满足各种数据处理量大和标准企业基础架构应用程序所需。AMD EPYC 9454 2.75GHz 48核处理器,支持DDR5-4800内存,配备256MB的高速缓存,功耗为290W。这些特性使得AMD EPYC 9454成为处理大量数据和运行复杂计算任务时的理想选择。AMD EPYC 9534让人印象最深刻的就是它的“均衡性”。它拥有2.45GHz基准频率、64个核心和256MB三级缓存,不仅性能更高,而且可以更高效地调配系统资源。在AI推理方面,AMD EPYC 9534是最优性价比之选。

AI无止境CPU再升级

未来,AI推理还有很长的路要走,包括推理分析、创意生成、情绪智能、多模态技术等,最终要与人类智能对齐。由此可见,支撑AI推理的服务器和CPU重任在肩。

随着数据量的迅猛增长,以及算法复杂性的持续提升,成本与技术复杂度方面的挑战与日俱增,需要不断增加新的内核、GPU等,在提高处理效率的同时,还要兼顾能耗等相关问题。乘着AI的翅膀,AMD EPYC处理器也要在高性能计算、安全性提升、能效优化以及适应未来新技术发展等方面百尺竿头,更进一步。